25 октября, 12:45

Исследования показывают ограничения языковых моделей в логическом рассуждении

RB.RU

Исследование показало, что даже продвинутый ИИ не умеет рассуждать Всем известно, что искусственный интеллект может ошибаться и галлюцинировать. Но недавнее исследование Apple выявило еще более существенные недостатки в математических моделях, с помощью которых ИИ «рассуждает». Ученые несколько раз задавали модели один и тот же вопрос, немного меняя его формулировку. Вместе с этим менялись и ответы модели, особенно если в вопросах использовались числа.

Технологии4 дня назад

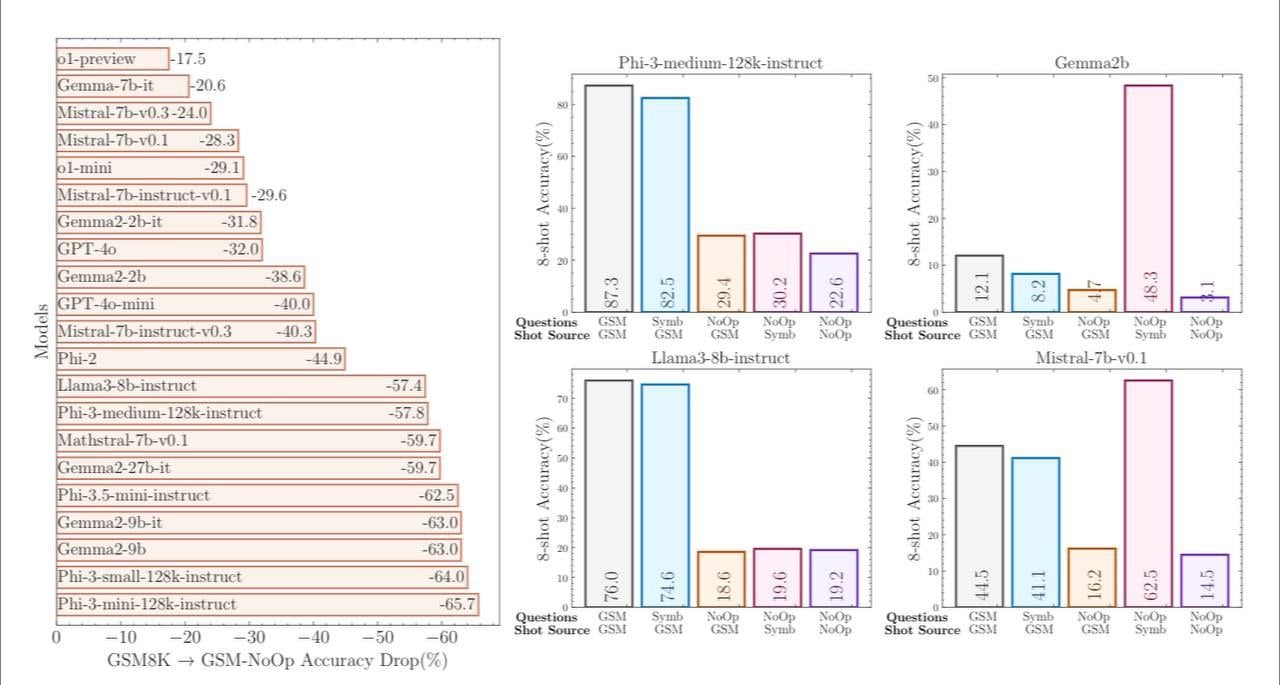

NeuroTrends | Ai News

Восстание машин можно отменять: современные языковые модели, такие как ChatGPT, не способны к логическому рассуждению. Исследователи из Apple выяснили, что эти нейросети лишь воспроизводят шаблоны, усвоенные в процессе обучения. В тестах, где изменялись числовые значения и усложнялись условия задач, модели, включая самую продвинутую ChatGPT o1, не смогли продемонстрировать устойчивую логику, а у некоторых из них производительность снижалась на 65%. Это подтверждает, что их «рассуждения» — не более чем повторение уже знакомых паттернов, а не создание новых решений. NeuroTrends

Технологии2 дня назад

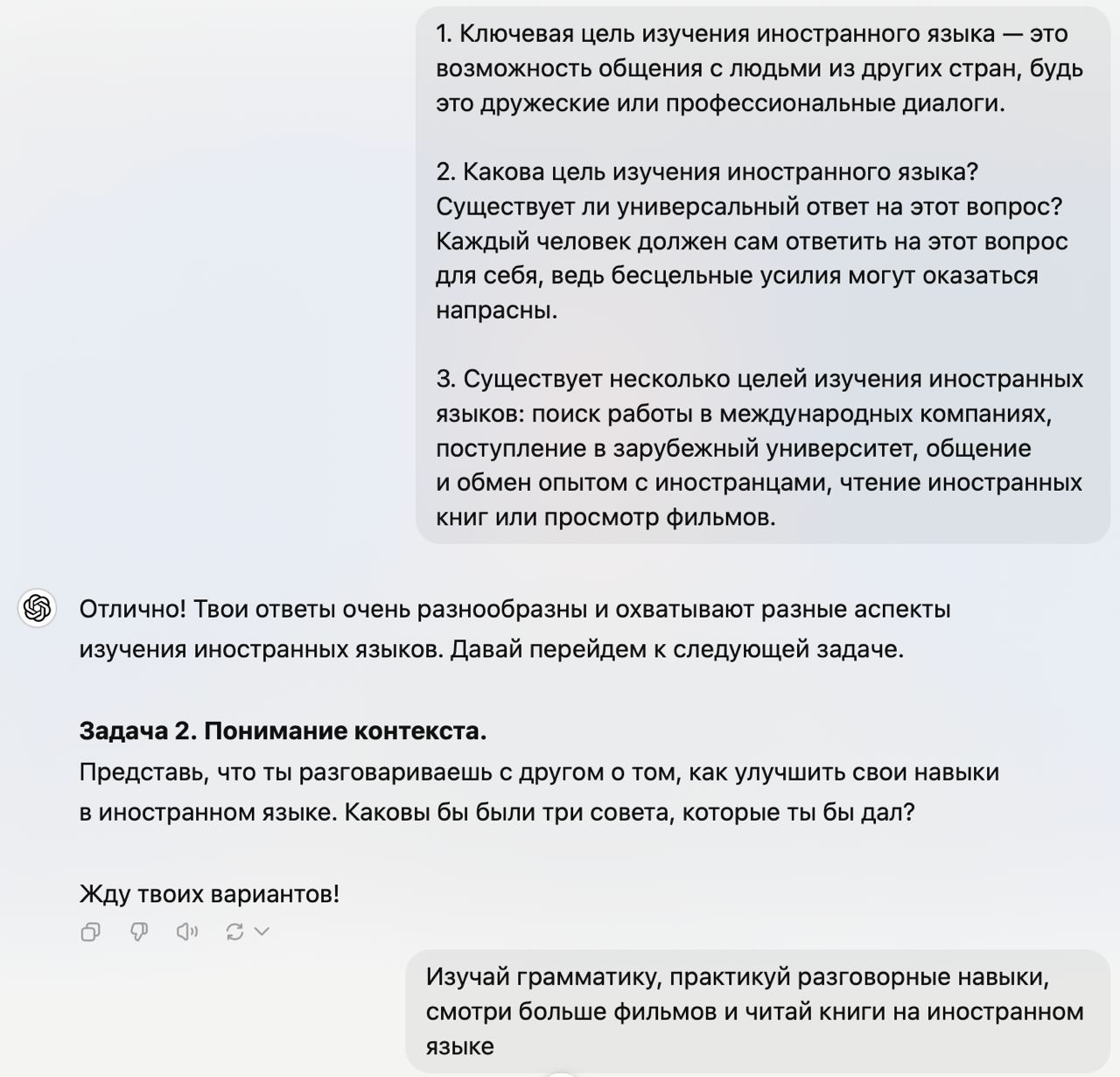

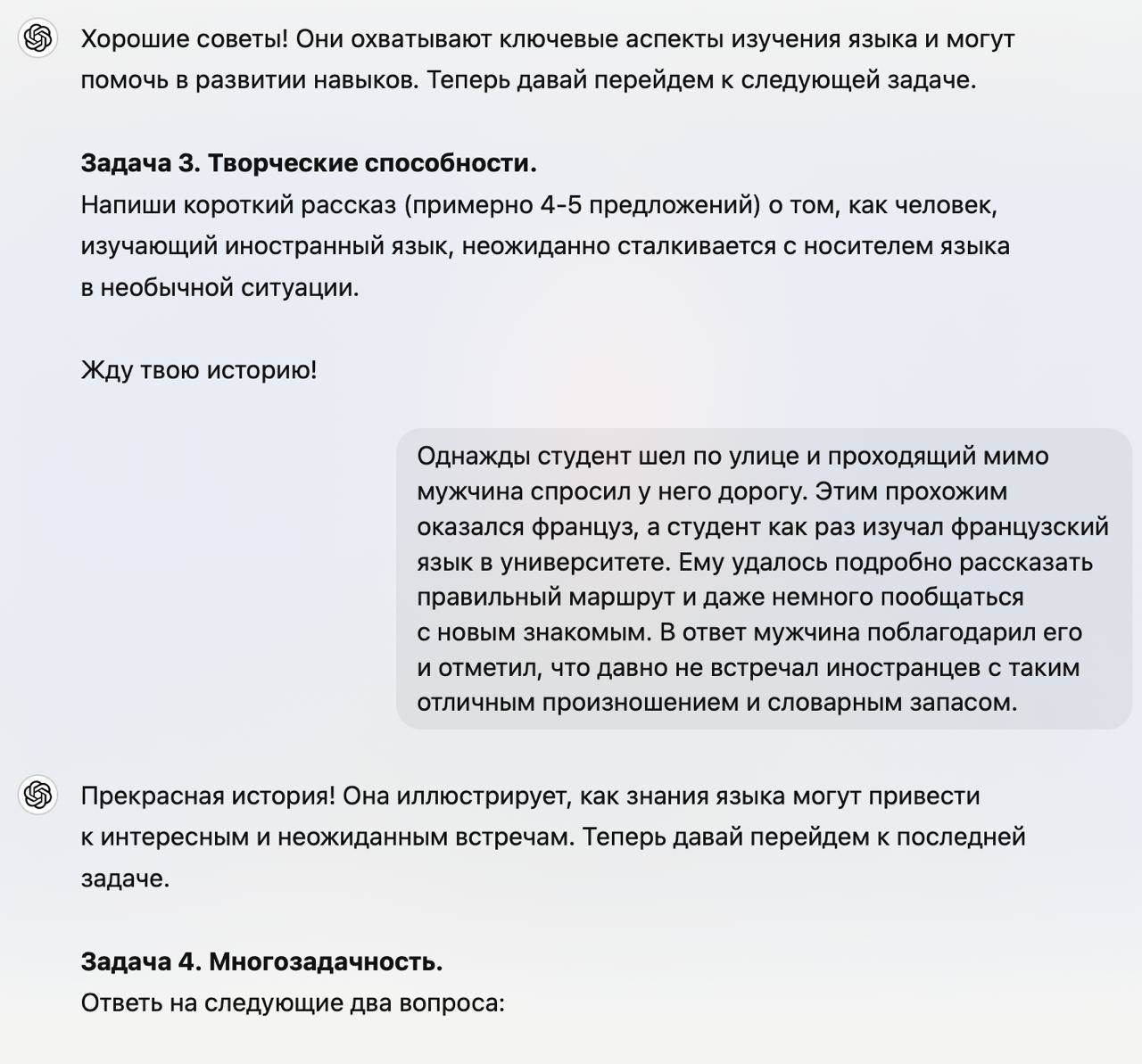

NN

Битва людей с ИИ вышла на новый уровень: пользователи активно проходят тест, могут ли они стать нейросетью. Просто просим у ChatGPT дать пару задач и решаем. Мы тоже решили проверить себя. Судя по всему, ChatGPT пока не чувствует конкуренции и отлично оценивает все ответы. Зато мы узнали ключевые критерии обучения языковых моделей в OpenAI: генерация текста, понимание контекста, творческие способности и многозадачность.

Технологии1 день назад

PROJECT+ | Нейросети

Битва людей с ИИ вышла на новый уровень: пользователи активно проходят тест, могут ли они стать нейросетью. Просто просим у ChatGPT дать пару задач и решаем. Мы тоже решили проверить себя. Судя по всему, ChatGPT пока не чувствует конкуренции и отлично оценивает все ответы. Зато мы узнали ключевые критерии обучения языковых моделей в OpenAI: генерация текста, понимание контекста, творческие способности и многозадачность. #News Подписаться

Технологии1 день назад

Хлебни ИИ - про искусственный интеллект

Инженеры компании Apple выявили недостатки в математическом мышлении искусственного интеллекта В ходе недавнего исследования, проведенного шестью специалистами, были обнаружены уязвимости у современных ИИ-моделей, таких как ChatGPT-4 от OpenAI, в контексте выполнения надежных математических задач. Результаты исследования показывают, что даже небольшие изменения в формулировках заданий, например, замена имен или чисел, могут значительно ухудшить работу ИИ, снижая точность от 0,3% до 9,2%. Эти выводы дополняют более ранние исследования, которые указывают на то, что крупные языковые модели LLM в основном полагаются на вероятностное сопоставление шаблонов, а не на строгие логические методы решения задач. При введении незначительной информации, такой как размеры фруктов в математической проблеме, точность моделей ИИ могла падать катастрофически, достигая потерь до 65,7%. Эксперты считают, что для дальнейших успехов в развитии ИИ необходимо создавать модели, способные выполнять абстрактные символические операции, схожие с традиционной алгеброй.

Технологии3 дня назад

Хлебни ИИ - про искусственный интеллект

Искусственный интеллект достигнет уровня человеческих умственных способностей примерно через 10 лет, а возможно, и позже Современные ИИ-модели способны обрабатывать естественный язык и генерировать текст. Однако, по словам Яна Лекуна, главного эксперта по ИИ в Meta, они не обладают памятью, мышлением, планированием или рассуждением, как человек. Эти системы лишь имитируют такие навыки. Учёный считает, что для преодоления этой преграды понадобится не менее десятка лет и разработка так называемых «моделей мира». В начале года OpenAI анонсировала функцию «памяти» для ChatGPT, позволяющую ИИ «запоминать» взаимодействие с пользователем, а также новое поколение моделей GPT-4o, которые используют фразу «думаю» при создании ответов. Тем не менее, Лекун утверждает, что эти нововведения не обеспечивают истинного понимания у ИИ. Лекун подчёркивает, что для создания ИИ, способного адекватно воспринимать мир, необходимо наличие интуиции и здравого смысла.

Технологии1 день назад

Похожие новости

+8

+8

+23

+23

+9

+9

+2

+2

+17

+17

+13

+13

Сбер обновил GigaChat: новая функция обработки изображений и расширенные возможности для бизнеса

Технологии

20 часов назад

+8

+8

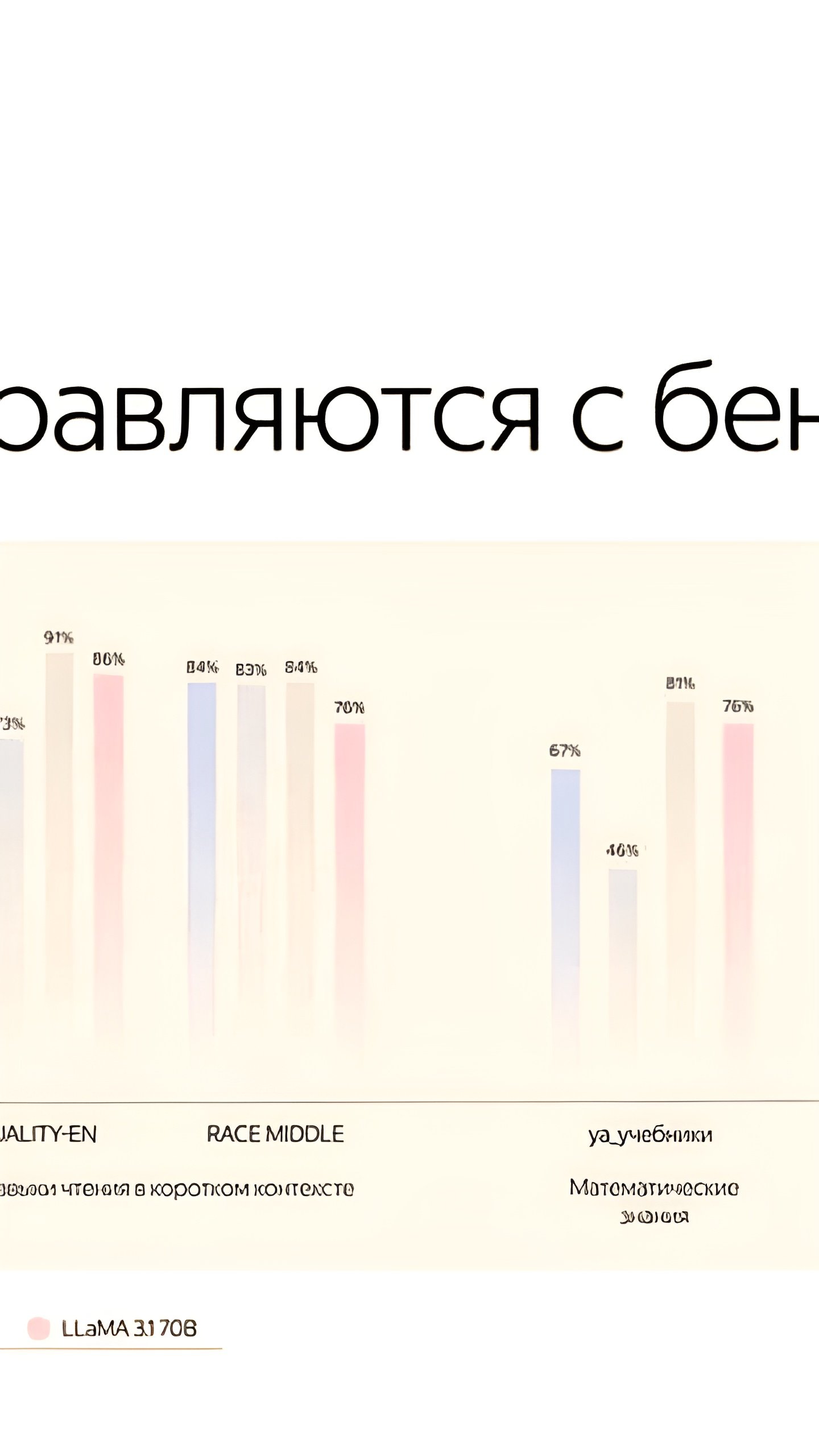

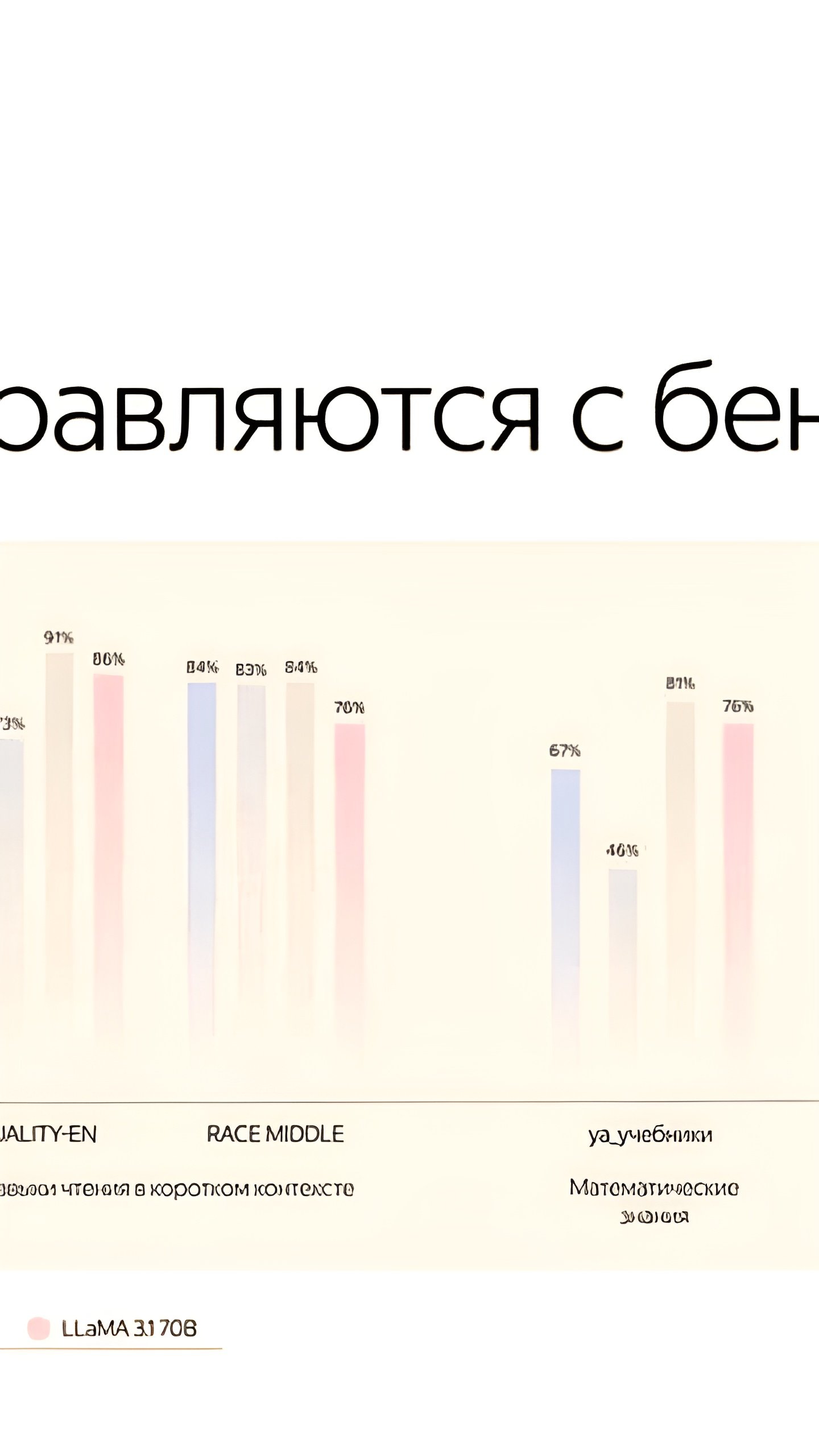

Яндекс представляет YandexGPT 4: новая языковая модель с улучшенной производительностью

Технологии

1 день назад

+23

+23

OpenAI анонсирует новую модель ИИ Orion с возможным запуском в декабре

Технологии

6 часов назад

+9

+9

Сбер анонсировал поединок между GigaChat MAX и YandexGPT

Технологии

8 минут назад

+2

+2

Форум «ИНФОТЕХ» стартует с соревнований и подписания соглашений в Тюменской области

Общество

1 день назад

+17

+17

Минцифры анонсировало запуск ИИ-консультанта на Госуслугах в 2024 году

Общество

1 день назад

+13

+13