8 ноября, 08:40

Мизулина предупреждает о рисках искусственного интеллекта на III Медиафоруме СНГ

NEWS.ru | Новости

Искусственный интеллект — угроза для человечества, заявила Мизулина. Глава «Лиги безопасного интернета» Екатерина Мизулина видит риски в использовании искусственного интеллекта. «Пока все обещает благо для людей, быстрый заработок, комфортную жизнь, но в какую сторону это пойдет дальше? Не случится ли так, что в какой-то момент искусственный интеллект решит, что человек — это ненужный элемент системы?» — задала риторический вопрос Мизулина, выступая на на III Медиафоруме стран СНГ «Развитие медиа в меняющемся мире».

Технологии1 день назад

IT News

Участники медиафорума стран СНГ «Развитие медиа в меняющемся мире» обсудили наиболее злободневные вопросы жизни медиа в странах СНГ, в том числе риски развития медиаотрасли и роль искусственного интеллекта в ней Глава «Лиги безопасного интернета» Екатерина Мизулина подчеркнула, что человек, получая любую информацию через соцсети либо мессенджеры, чаще всего воспринимает ее очень личностно и склонен доверять этой информации. Особенно если это ему пересылают знакомые, близкие и друзья. Уровень доверия к этой информации, потребляемой через соцсети, крайне высокий. Многие ресурсы и медиа в соцсетях стали крупнее, чем традиционные СМИ, и охват их аудитории уже намного выше, - пояснила она. Также Мизулина рассказала о деятельности групп, распространявших фейки в Беларуси в 2020 году и Казахстане в 2022 году: Делали это по одной простой причине. Зачастую крупные провокаторы, эти медиа онлайн-ресурсы, которые распространяли различные экстремистские призывы, угрозы и дезинформацию, в последующем распространяют ее и на территории нашей страны. Было интересно даже аналитически наблюдать, как группы, каналы, которые распространяли провокации на территории России, в какой-то момент переключились на Казахстан. Участники в том числе обсудили влияние ИИ на работу журналистов. Пример попытки внедрить ИИ в работу привел исполнительный директор по медиа Rambler&Co Андрей Цыпер: Основное потребление сейчас связано с новостями, с короткими материалами. Лонгриды читает очень мало людей. Это должно быть что-то очень интересное, во что человек готов проинвестировать свое время. Потребляют 500 знаков максимум, картинку или короткое видео. И после того, как ты ставишь задачу генеративной сети и получаешь материал, то на то, чтобы его переписать, проверить и привести в соответствие редакционным форматам, времени уходит больше, чем если написать с нуля. #IT_News #СНГ #медиа #дезинформация #ИИ Подписаться

Технологии21 час назад

NEWS.ru | Новости

Искусственный интеллект «похоронил» заживо Пугачеву. Об этом заявила глава «Лиги безопасного интернета» Екатерина Мизулина. По ее словам, недавно поисковик «Яндекс» на запрос «Алла Пугачева» выдавал адрес кладбища. Оказалось, что искусственный интеллект просто нашел публикацию, где певица рассказывала о том, что она купила место на кладбище.

Технологии1 день назад

Trend Wave

Искусственный интеллект помогает в защите от киберпреступлений. По словам первого зампреда правления Сбера Александра Ведяхина, 91% кибератак происходят из-за ошибок людей. На Демо-дне в рамках международного IT-акселератора Sber500 был представлен стартап в сотрудничестве с Ai-сервисом GigaChat, которая понизит киберуязвимость на 20%. Новая платформа для обучения кибербезопасности окажет огромное влияние на борьбу с фишингом и другими угрозами через интерактивные симуляции и адаптивные программы. Все благодаря помощи GigaChat, который анализирует мошеннические схемы и дает рекомендации по их обезвреживанию.

Технологии18 часов назад

360 новости

Эксперты и медиаменеджеры обсудили будущее СМИ в меняющемся мире Ситуация на информационном поле меняется стремительно. Те закономерности, которые считались базовыми еще несколько лет назад, сегодня уже не работают. В нашу жизнь прочно вошло такое неприятное понятие, как "фейк". Социальные сети не только радуют фотографиями котиков, но могут представлять серьезную опасность в частности, для подростков . Аудитория не читает информацию, объем которой превышает 500 знаков, а отдельный человек, собрав вокруг себя подписчиков, может перегнать в популярности и цитируемости традиционные СМИ.

Технологии16 часов назад

Ядерный Контроль

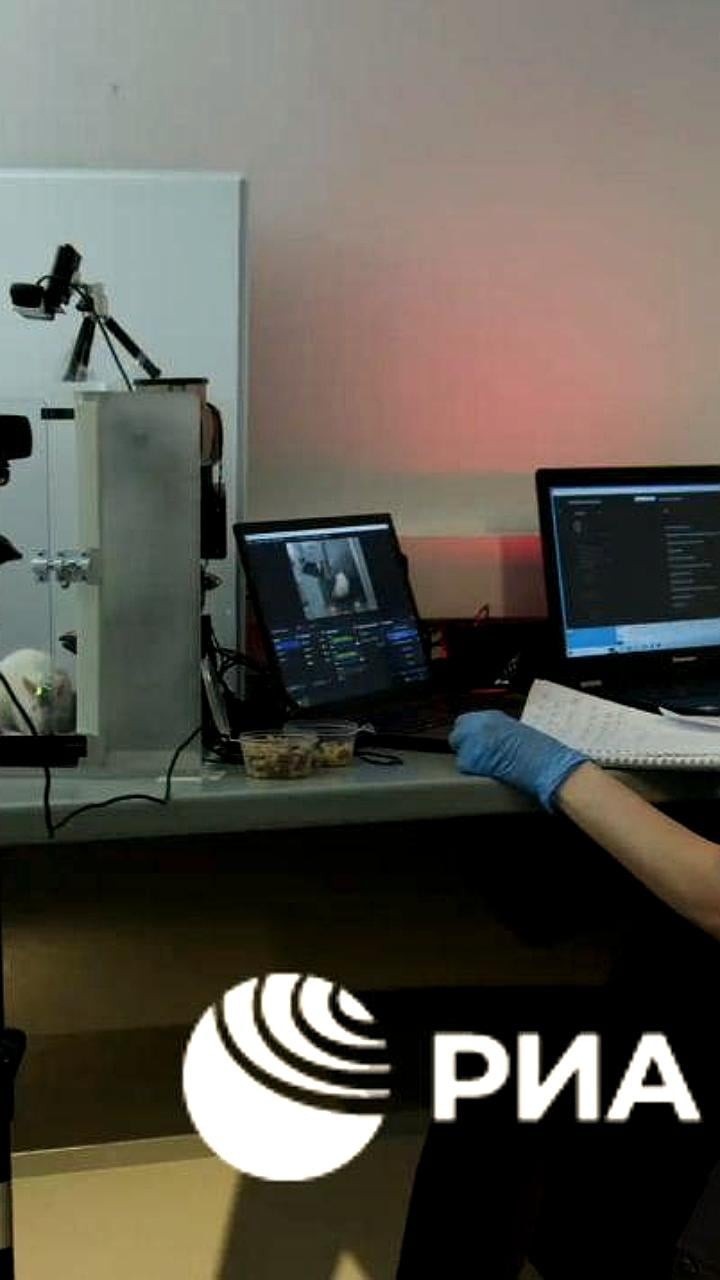

Искусственный интеллект и смертоносные автономные системы стали одной из наиболее острых тем в сфере международной безопасности в последние годы. Развитие технологий, таких как беспилотные летательные аппараты, автономные роботы и кибероружие, несет как преимущества на поле боя, так и значительные риски для международной системы. Одни утверждают, что такие технологии могут повысить точность и эффективность военных операций, а также сократить человеческие потери, другие же предупреждают о непредсказуемых последствиях и угрозах, связанных с использованием искусственного интеллекта в военных целях. В условиях отсутствия достаточных международных норм регулирования эти технологии могут представлять новые вызовы для глобальной стабильности и безопасности, а вопрос контроля над ними становится крайне актуальным для международного сообщества. Так, состоялась лекция Андрея Юрьевича Малова, члена Экспертного совета ПИР-Центра, на тему: «Искусственный интеллект и смертоносные автономные системы: риски для международной безопасности», в ходе которой участники обсудили вопросы современных вызовов и угроз, связанных с развитием новых технологий, а также их влияние на баланс сил в мире и изменение мирового порядка. Смотреть запись лекции на нашем сайте #yaderny_kontrol #analyses

Технологии5 часов назад

Похожие новости

+1

+1

+6

+6

+4

+4

+3

+3

+67

+67

+10

+10

Кремль рассматривает возможность внедрения искусственного интеллекта в госуправление

Общество

21 час назад

+1

+1

Путин подчеркивает важность суверенного искусственного интеллекта в России

Общество

14 часов назад

+6

+6

Сбербанк предсказывает рост кибермошенничества в 2025 году

Происшествия

1 день назад

+4

+4

Исследования показывают влияние ИИ на эмоции и взаимодействие людей

Технологии

1 день назад

+3

+3

Российские ученые подключили мозг крысы к нейроинтерфейсу с ИИ

Наука

1 день назад

+67

+67

Почта России и Ростелеком подписали соглашение о сотрудничестве в кибербезопасности

Общество

1 день назад

+10

+10